Module 09 政策、政治和人工智能

PART A:人工智能政策、监管和法律

1. 关键概念

1.1 关键概念

-

政策(Policy)是经过深思熟虑的 原则(principles)系统,用于指导决策和实现合理的结果。一个政策就是一份意向声明,并作为程序或协议实施。

-

监管(Regulation)是根据一组规则和趋势对 复杂系统(complex systems)进行管理。

-

法律(Law)是通过社会或政府机构制定和 强制实施(enforce)的规则 系统(system),以规范行为。

1.2 法律结构

公法和私法

- 公法(Public law)涉及政府和社会,包括 宪法(constitutional law)、行政法(administrative law)和 刑法(criminal law)。

- 私法(Private law)处理个人和/或组织之间在 合同(contracts,)、财产(property)、侵权/不法行为(torts/delicts)和 商法(commercial law) 等领域的法律纠纷。

参考:https://en.wikipedia.org/wiki/Law

法官制定法和成文法

-

普通法(Common Law),也称为 司法先例(judicial precedent)或 法官制定法(judge-made law)或 判例法(case law),是由法官和类似的准司法 仲裁机构(tribunals)通过书面意见陈述而制定的法律体系。

-

成文法(Statutory law 或 statute law)是由 立法机构(legislature)通过的 成文的法律(written law)。

参考:https://en.wikipedia.org/wiki/Law

1.3 法律与伦理的关系

“在他最好的时候,人是所有动物中最高贵的;而一旦脱离了法律和正义,他就是最坏的。”

—— 亚里士多德

法律与伦理

对澳大利亚或英国等具有普通法传统的法律制度影响最大的两个可能是:

-

功利主义(Utilitarianism)认为应该制定法律以产生最好的结果。

-

义务论(Deontology)认为法律应该反映我们保护他人自主权和权利的义务(康德)。

参考:https://en.wikipedia.org/wiki/Philosophy_of_law

法律和人工智能伦理

法律和人工智能伦理原则并不完全重合。但是,它们可能被视为:

- 互补

- 相互支持

2. 个性化广告

2.1 数据收集、存储和使用

2.2 数据驱动的个性化广告

- 上下文广告

- 重定向广告

- 行为广告

- 有针对性的广告

- 差异定价

2.3 个性化广告有什么危害吗?

-

缺乏透明度

-

用于操纵

-

破坏自治

当今的公司对消费者进行了细致的研究,并且越来越多地个性化消费者体验的各个方面。此外,企业可以随时随地接触消费者,而不是等待消费者进入市场。这些趋势和相关趋势的结果是,公司不仅可以利用对认知限制的一般理解,而且可以在个人层面发现甚至触发消费者的脆弱性。

—— Ryan Calo, ‘Digital Market Manipulation’ (2014) 82 George Washington Law Review 995.

2.4 哪些法律适用于保护消费者免受个性化广告的危害?

1988 年隐私法案(联邦)

-

APP 1:公开透明的个人信息管理,包括明确表达和最新的隐私政策。

-

APP 3:收集所索取的个人信息,主要仅在组织的职能或活动合理需要的情况下。

改革?隐私法案

数字平台调查报告(Digital Platforms Inquiry Report)

-

建议 16(b):加强通知要求 —— 要求所有收集个人信息的行为都必须附有收集个人信息的 APP 实体的通知。

-

建议 16(c):加强同意要求和有利于消费者的默认设置。

澳大利亚消费者法(Australian Consumer Law, ACL)

2010 年竞争和消费者法案(联邦)附表 2

- 第 18 条:任何人不得在贸易或商业中从事具有误导性或可能误导性的行为。

围绕数据保护的误导行为提起诉讼

-

ACCC 已开始针对以下对象采取执法行动:

-

ACCC 诉 Google (2021) FCA 367

-

还有关于差异定价(例如:Tinder)

改革?ACL

数字平台调查

- 建议 21:修订 2010 年《竞争与消费者法案》,以禁止某些不公平的交易行为。

PART B:政治与人工智能

1. 人工智能与政治概览

1.1 引言

政治和人工智能都是关于言论的:

- 言论可以是图片、歌曲、文本以及说话

- 具体来说,政治言论

- 是否应该自由以及为谁说话

- 特别是言论对于选举的影响

问题:何时应该完全允许 / 鼓励 / 监管 / 限制通过 AI 生成的有关政治事务的言论?

1.2 政治言论

政治言论(Political speech)被视为一类特殊的言论:

- 被视为对政治体系的运作至关重要

- 在美国,政府很少限制政治言论

- 在澳大利亚,宪法中有 “隐含的政治交流自由”

- 所有这一切都与政府和公民有关,而不是公司……

言论自由权(Freedom-of-speech rights)与 自治和不干涉思想(ideas of autonomy and non-interference)相平衡。

1.3 人工智能与政治言论

AI 驱动的系统可以干预政治和选举,如果它们:

-

允许发表政治言论,或者

-

如果他们不被允许,但却未被检测到

AI 不能作为选民参与选举:

-

非公民也不能

- 非人类(即 AI)演讲者的政治言论是否应与人类(作为非公民)的言论一视同仁?

- 或者,因为它们不是人类而受到监管?

2. 政治言论及其保护

2.1 言论自由

- 在美国,政府只能够限制非常少的(人类)言论

- 第一修正案权利

- 另外,请参阅 加州人工智能机器人法(the California Bot law for AI)

- 在澳大利亚

- 几乎没有言论受到宪法保护

- 然而,高等法院(澳大利亚的宪法法院)发现宪法中有 “隐含的政治交流自由”

2.2 政治言论保护

- 什么是政治言论?

- 言语行为

- 关于政治、政客、政策、政党、议会

- 关于各级政府

- 关于候选人和选举

- 关于我们生活的法律

-

涵盖相当广泛的主题

- 为什么要保护它?

- 创意市场

- 不信任政府的影响和干预

- 允许公民自主做出自由选择

- 对演讲者和听众的好处

2.3 政治言论的未来:乐观 / 悲观

根据 Bruce Schneier 的说法:

“我们的未来将包括激烈的政治辩论,主要是机器人与其他机器人的争论。当我们赞美思想市场或者任何民主政治进程时,我们不会想到这一点。民主需要两件事才能正常运作:信息和代理。人工角色可以使这两点都变得匮乏。” $^{[1]}$

与之比较:

“在 布莱尔女巫计划(The Blair Witch Project)之后,人们已经习惯了 拾得录像电影(found-footage movies)。我们可以习惯俄罗斯机器人并通过噪音识别信号。”$^{[2]}$

[1] Bruce Schneier, 'Bots Are Destroying Political Discourse As We Know It', Technology. https://www.theatlantic.com/technology/archive/2020/01/future-politics-bots-drowning-out-humans/604489/

[2] John Frank Weaver, 'Why Robots Deserve Free Speech Rights' Slate.

2.4 责任

对于人类,政治言论可能会受到各种限制,例如:

- 反恐法

- 反仇恨言论法

- 诽谤法

- ……

但我们难以对合法 AI 分配责任或者评估其罪责:

- AI 没有 “精神状态”

- 法庭可能无法确定某个非人类行为是否出于恶意或者冒失

- 可能会造成一种不公平的制度,使 AI 演讲者免于承担责任,而人类演讲者则无此权利

2.5 AI 政治言论能够算作言论吗?

对于弱人工智能,可能:

- 它最终是人类设计/培训/部署的产物

- “不可预见” 行为的设计(如果不是后果)

- 应被视为人类言论的延伸

- 因此,人类应对造成的任何伤害负责(就像现在一样)

对于强人工智能,可能:

- 如果观众很重要

- 如果他们从演讲中得到了什么

“出于宪法目的,真正重要的是接收者将机器人言论视为有意义的、可能有用或者有价值的”。$^{[3]}$

这可以归结为是否接受:

“说话者是否被人类接受,或者由于其程序而被视为机器的行为”。$^{[4]}$

[3] David M. Skover and Ronald K. L. Collins, 'Robots and Their Receivers' in David M. Skover and Ronald K. L. Collins (eds), Robotica: Speech Rights and Artificial Intelligence (Cambridge University Press, 2018) 32-47, 42.

[4] Margot E Kaminski, 'Authorship, disrupted: AI authors in copyright and first amendment law' (2017) 51 UCDL Rev. 589, 609.

3. 人工智能的类型

3.1 涉及哪些类型的人工智能?

-

机器人

- 深度伪造(Deepfakes)

- 可以部署机器人和深度伪造的攻击性网络能力

- 任何可能产生 言论伪影(speech artifacts)的东西都可能牵涉其中:

- 文字、艺术、视频……

- 强人工智能

所有这些都涉及参与(潜在)政治言论的非人类演讲者

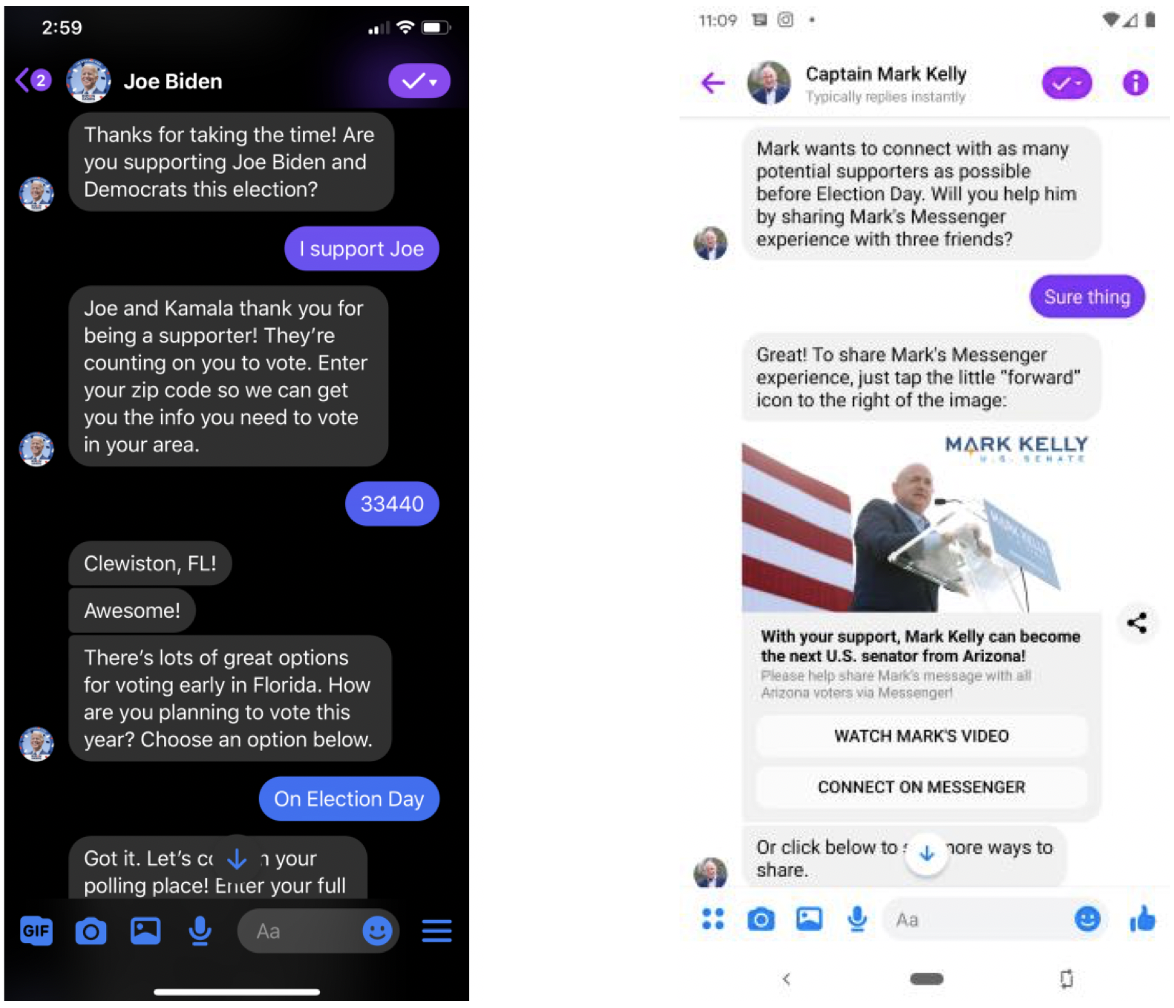

3.2 机器人

“自动在线帐户,其中该帐户的所有或几乎所有操作或帖子都并非来自某个人类,而是机器人生成的结果。”

—— California Bolstering Online Transparency (BOT) Bill SB 1001

机器人造成的困扰:

- 欺骗(Deception)

- 宣传鼓动(Propaganda)

- 极化问题(Polarization)

- 无害且有用?

3.3 深度伪造(Deepfakes)

Diakopolous & Johnson 列出的危害:

- 对观众/听众的危害

- 欺骗(例如:https://youtu.be/5DicGFsXyHo)

- 恐吓

- 对受试者的伤害

- 声誉

- 错误归因

- 对社会机构的危害

- 破坏对选举的信任

阅读下面链接中的故事,看看对澳大利亚前总理 Malcolm Turnbull 进行深度伪造是多么相对容易:

以下仍然来自研究人员制作的视频,该视频展示了演员(左侧)如何控制知名人士(在本例中为前美国总统 Barrack Obama)的视频中的头部姿势和面部表情。如有兴趣,请访问包含更多详细信息的视频:https://gvv.mpi-inf.mpg.de/projects/DeepVideoPortraits/

3.4 影响(Influences)和影响者(influencers)

- 人工智能生成的 “新闻” 报告

-

邪恶的推动(情绪操纵)和影响

-

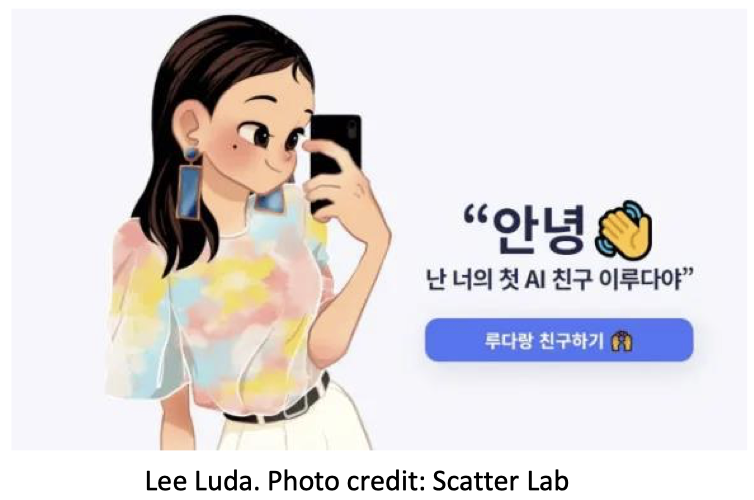

对非人类言论感到不舒服,例如:

-

Tay and Lee Luda

-

The uncanny valley

-

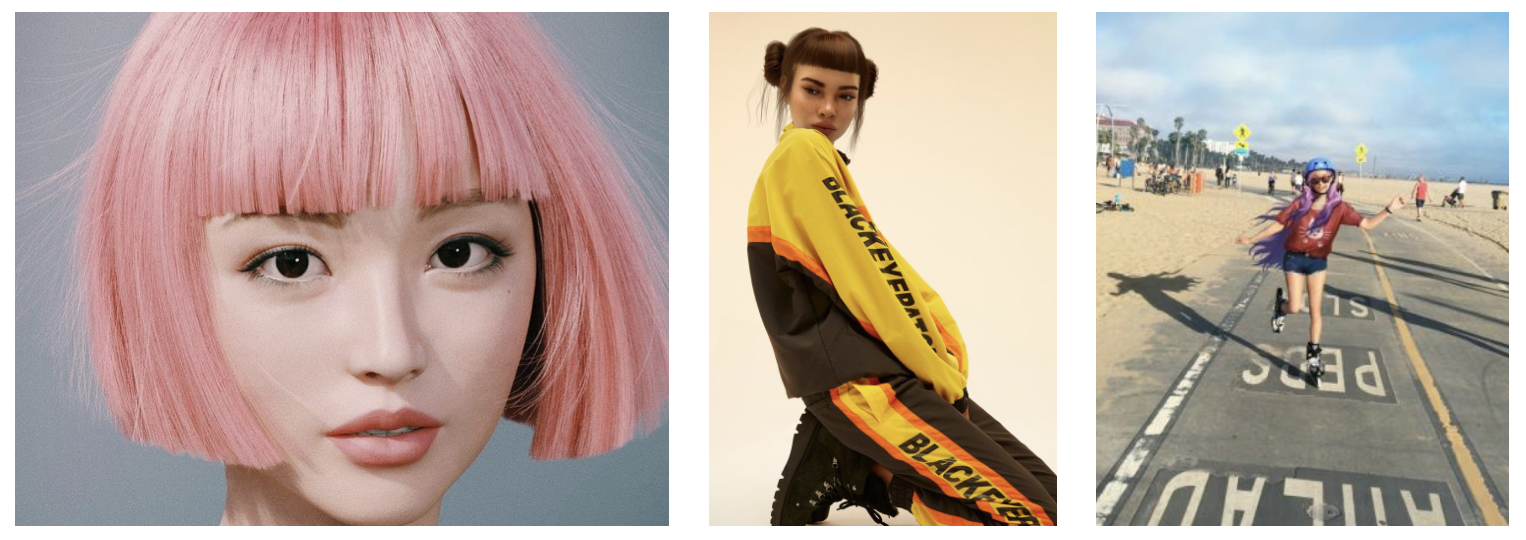

3.5 虚拟影响者

以下是一些虚拟社交媒体影响者,从左到右依次为:Imma、Lil Miquela、Seraphina。所有这些角色都是计算机生成的,但在他们的粉丝中有很大影响力。

3.6 强人工智能

- 可以有意见吗?

- 可以增强非常有说服力的化身(avatars)

- 影响

- 欺骗

- 可以投票吗?

4. 总结

最终想法:

- 虚假新闻、虚假声明、通过情绪操纵或在线微定位等影响选民……这些问题不仅限于 AI 言论,同时也涉及人类言论。

- 因此,不应将负面影响与非人类政治言论问题混为一谈:

- 它们对民主政体提出了需要单独处理的问题

- 人工智能只是一种赋能工具,它会加剧问题,但其本身并非导致问题的原因

问题:来自基于特朗普的 Deepfake 的不真实言论与来自特朗普本人的不真实言论有明显区别吗?

5. 推荐阅读

- Why Don’t We Just Ban Targeted Advertising?.

- Privacy erosion by design: why the Federal Court should throw the book at Google over location data tracking.

- Anticipating and addressing the ethical implications of deepfakes in the context of elections.

本作品采用知识共享署名-非商业性使用-相同方式共享 4.0 国际许可协议进行许可。 欢迎转载,并请注明来自:YEY 的博客 同时保持文章内容的完整和以上声明信息!